-

Python pip命令大全

Python pip 使用命令大全分享 官方文档 地址:https://docs.python.org/3/installing/index.html 命令大全 安装模块 pip install 模块名 通常,如果已经安装了模块,再次安装 它再次不会有任何效果。如需要升级 请使用升级命令。 不加版本号 默认安装模块当前最新版本。 安装指定版本 pip install 模块名==1.xx 指定源安装…... 塵風

塵風- 0

- 0

- 481

-

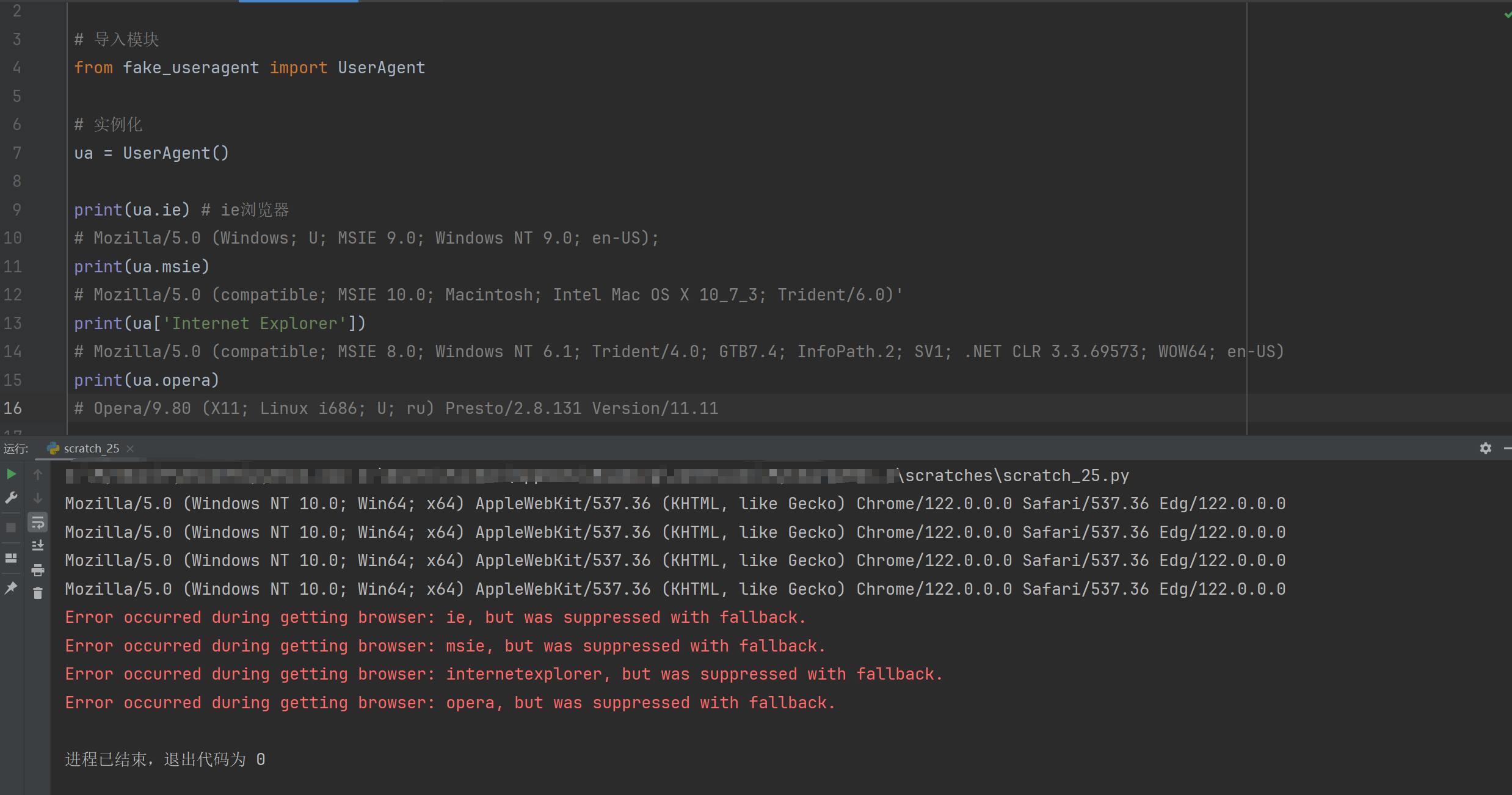

Python爬虫:设置随机User-Agent模块fake-useragent

Python爬虫:设置随机User-Agent模块fake-useragent介绍和使用。 模块简介 GitHub地址 https://github.com/hellysmile/fake-useragent UA数据来源 目前1.5x的版本我看GitHub介绍数据是从 https://user-agents.net/ 下载的。下面的使用的部分示例是1.2或者1.3版本新增的功…... 塵風

塵風- 0

- 0

- 3.5k

-

网站被黑,被搜索引擎收录垃圾信息删除处理教程

现在有非常多的站点被黑导致网站被搜索引擎收录了许多的色情、赌博信息,导致网站被降权,或者搜索品牌词的时候出现的站点信息变成了垃圾信息等情况,尽管有的企业不依赖SEO转化,但是品牌词有搜索量的公司遇见这种情况也是比较重要的问题。 注意:这篇文章是教你怎么处理/删除:被搜索引擎收录垃圾信息,而不是教你处理网站被黑(至于网站被黑这问题怎么处理,则太宽泛了,问题原因数不胜数,不是一篇文章说的清楚的)。 处…... 塵風

塵風- 0

- 0

- 1.4k

-

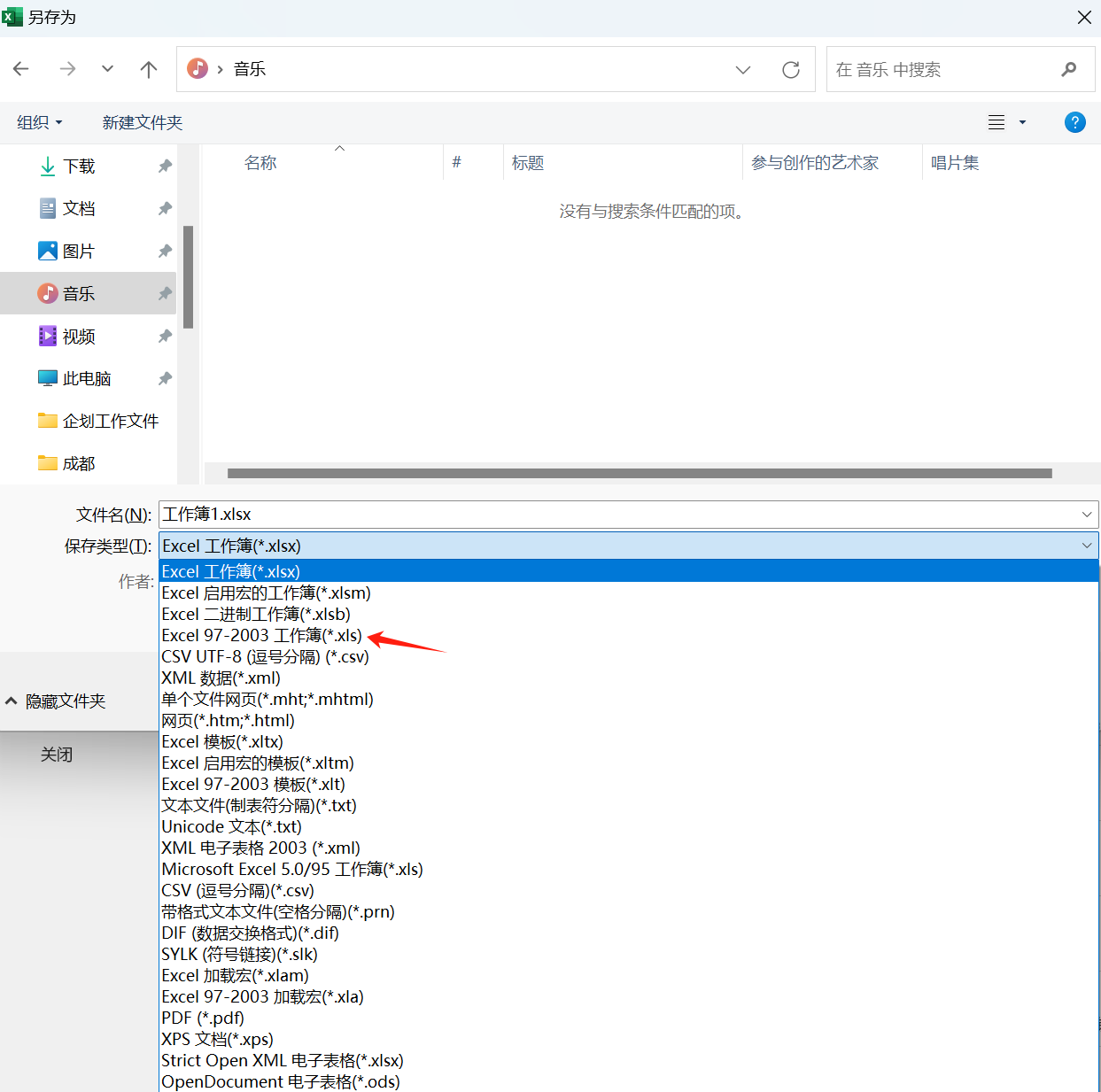

Python xlrd 报错xlrd.biffh.XLRDError: Excel xlsx file; not supported异常解决

之前我分享了:Python Excel常用操作库+使用笔记分享,有Python基础的小伙伴想学习下Python操作Excel进行自动化办公或者是进行数据保存到Excel就可以参考学习,今天来分享下Python xlrd 报错xlrd.biffh.XLRDError: Excel xlsx file; not supported…这个异常的解决办法(我猜大部分人是因为以前学习了xlrd 然后直接co…... 塵風

塵風- 0

- 0

- 908

-

Python reversed 函数 – 对序列进行逆序操作

Python reversed 函数是一个Python内置函数,它可以对序列进行逆序操作。 序列可以是列表、元组、字符串等,通过使用reversed()函数,我们可以快速简便地将序列中的元素进行逆序排列。我们也可以用它来实现for循环反向遍历。 reversed()函数语法 reversed(sequence) 参数 sequence即是要进行逆序操作的序列( tuple, string…... 塵風

塵風- 0

- 0

- 443

-

Python获取两个列表的交集

python获取两个列表的交集方法分享:记录了三个Python获取两个列表的交集的方法,它们分别使用:列表转集合、for循环、列表推导式配合lambda函数实现,具体的示例代码如下: 方法一 列表转集合 推荐 集合操作符& 将两个列表转换为set集合,然后使用集合操作符&求解两个set集合的交集 # -*- coding: utf-8 -*- list1 = ['…... 塵風

塵風- 0

- 0

- 928

-

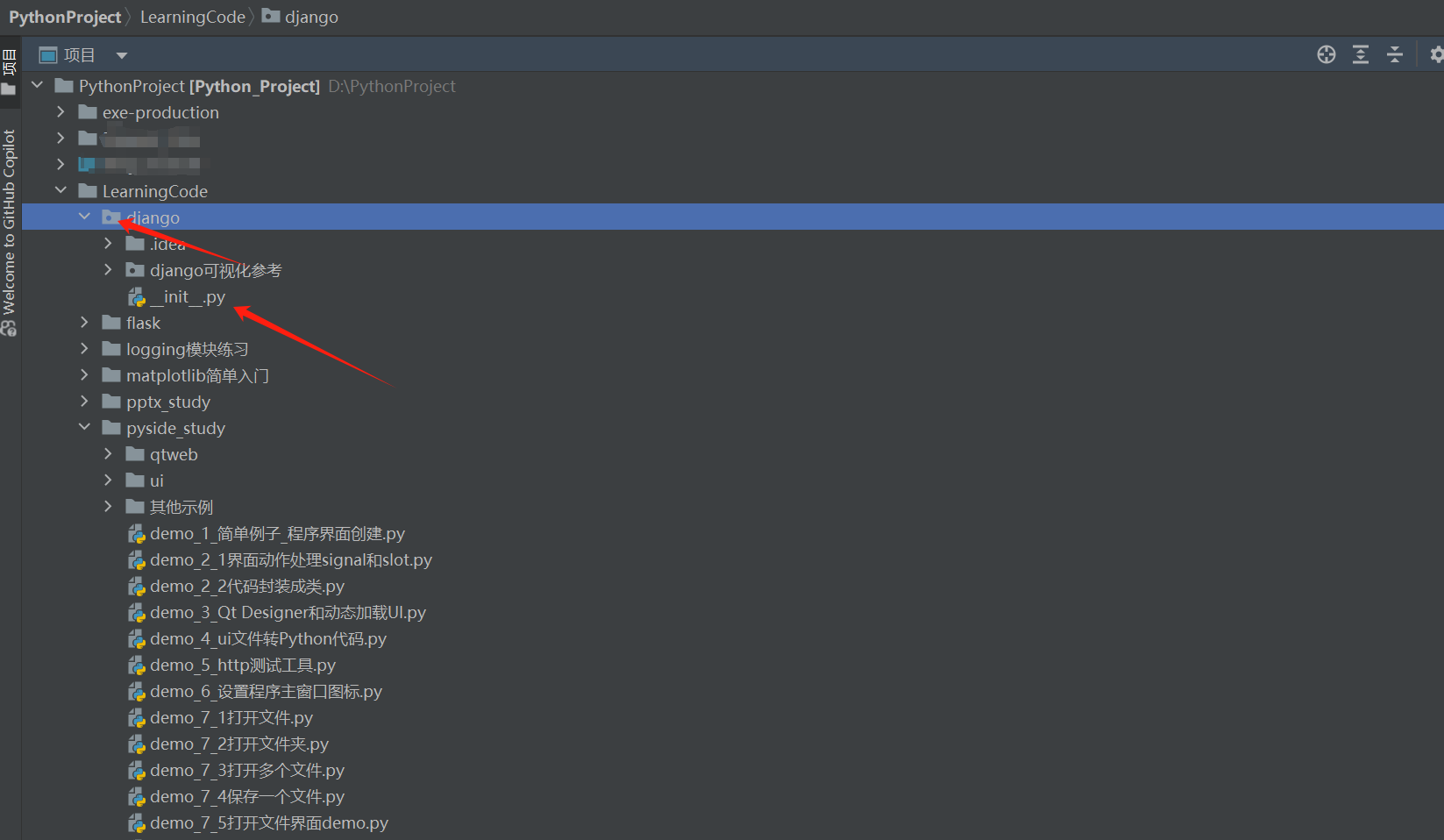

Pycharm项目目录文件夹图标小圆点代表什么意思

Pycharm项目目录文件夹图标小圆点代表什么意思:带小圆点的目录则代表这是一个Python的包,这个目录里面会有__init__.py文件。 如下图所示: 带点和不带点区别 带有小圆点的文件夹目录是packkage,即Python的包,里面会有__init__.py文件 没有点的是一个directory,即是普通的文件夹 在文件夹添加或者删除__init__.py文件,它就会变成包或者普通文件夹…... 塵風

塵風- 0

- 0

- 1.2k

-

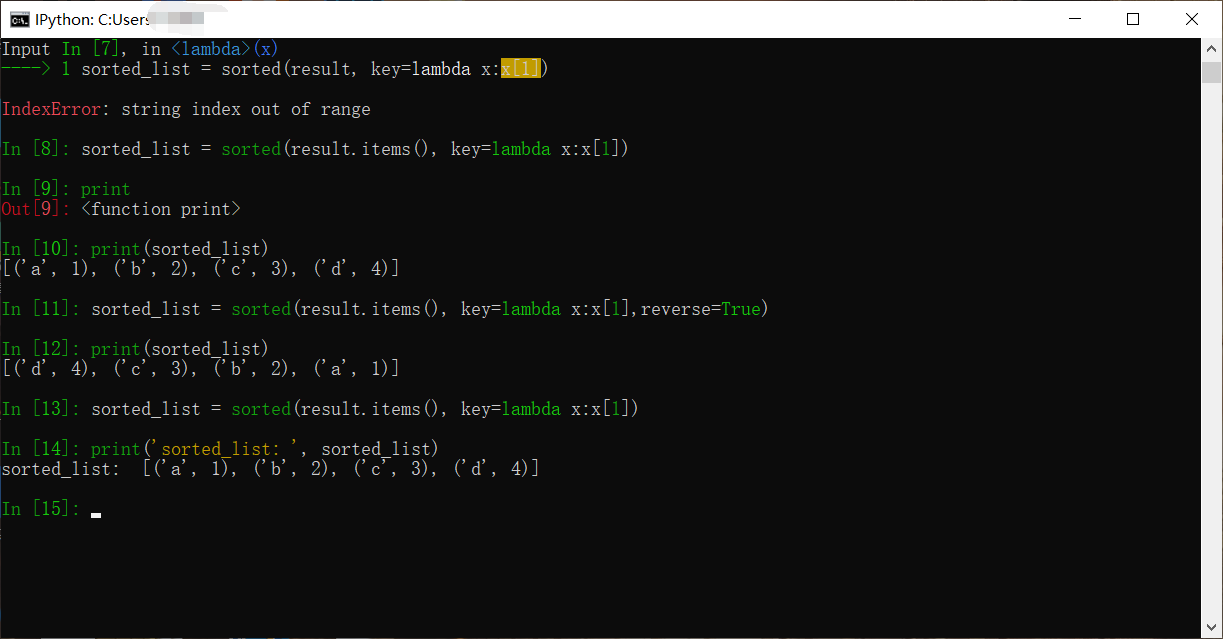

Python3 sorted() 函数 – 对所有可迭代的对象进行排序操作

sorted() 函数描述 Python3 sorted() 函数是python 3 中的一个内置函数,sorted() 函数作用是可以对所有可迭代的对象进行排序操作。 PS:有时候我们需要对拿到的字典之类的数据进行排序,就可以直接使用这个函数,而不需要进行for循环这样的操作去处理啦,如果数据是列表的话,也可以使用sort()函数,具体可以看我之前的文章:python sort()函数详解。 s…... 塵風

塵風- 0

- 0

- 1k

-

python转换Unix时间戳

python 转换Unix时间戳可以使用python中的time模块和datetime模块 time # -*- coding: utf-8 -*- import time # new_date = time.ctime(Unix时间戳) new_date = time.ctime(1567764428) print(new_date) # Fri Sep 6 18:07:08 2019 date…... 塵風

塵風- 0

- 0

- 1.5k

-

Python拼接URL:urllib.parse urljoin使用

Python拼接URL可以使用urllib.parse中的urljoin方法,urllib是Python中一个用于URL 处理的模块,urllib.parse 用于解析 URL,在之前分享的Python从路径|URL中获取文件名、文件后缀的方法中提到过使用其中的urlparse方法解析URL,感兴趣的可以去看看。 urllib.parse模块的的urlparse和urljoin刚好是两个相反的功能…... 塵風

塵風- 0

- 0

- 1.1k

-

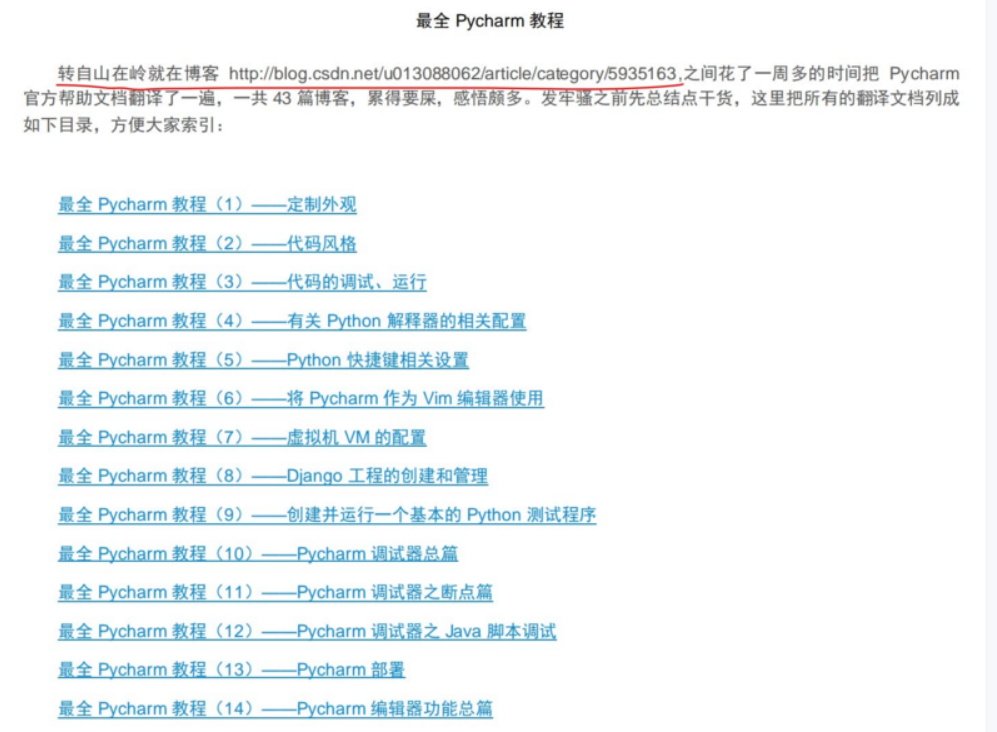

PyCharm中文指南、教程-百度云免费

今天分享的PyCharm中文文档的相关资源,有相关接触的可以考虑收藏,熟悉编辑器可以有效的帮助我们提高我们的编程效率,在方便新手学习使用的同时在使用中遇到各种Pycharm编辑器相关问题,可以查找帮助解决,以备不时之需! PyCharm是什么,这里就不扯了,点进这里来的我想到都知道PyCharm是什么,文章下面也有一点网上复制过来的pycharm简介,之前也分享过:Pycharm安装详细教程(非常…... 塵風

塵風- 0

- 0

- 2.2k

-

Python Counter()函数介绍 – 统计值出现的次数

Python Counter()函数介绍 Counter()函数 是collections模块(Python标准库中的一个模块)中的里面的一个类,作用是计算出字符串或者列表等中不同元素出现的个数,返回值可以理解为一个字典,所以对传回来的统计结果的操作都可以当作对字典的操作(Counter类继承dict类,所以它能使用dict类里面的方法) Note: 字符串还有一个内置的count(),只能统计字…... 塵風

塵風- 0

- 0

- 3.5k

-

Python 字典判断键是否存在

Python 字典判断键是否存在可以使用has_key()方法、 __contains__(key)方法、in 操作符。下面是详细介绍和实例代码: has_key()方法 Python 字典(Dictionary) has_key() 函数用于判断键是否存在于字典中,如果键在字典 dict 里返回 true,否则返回 false。 注意:Python 3.X 不支持该方法。 语法 has_key(…... 塵風

塵風- 0

- 0

- 1.6k

-

Python for 循环列表每次取值指定个数元素

Python中的for循环是我们非常经常使用的语句,for 循环用于迭代序列(即列表,元组,字典,集合或字符串),会将序列里面的值依次取出,有些时候我们需要循序一次取值多个元素就不行了,所以这篇文章来分享下Python for 循环每次从列表中取指定个数元素方法:我们可以使用range() 函数获取列表长度然后指定步长配合列表索引取值的方式来实现,下面是示例代码: 示例代码 range() 函数简…... 塵風

塵風- 0

- 0

- 605

-

Python requests 异常Max retries exceeded with url: 请求地址… (Caused by SSLError(SSLCertVerificationError(1, ‘[SSL: CERTIFICATE_VERIFY_FAILED] certificate verify failed: unable to get local issuer certificate (_ssl.c:1129)’)))”))}解决

今天在写爬虫的时候遇见了如下错误: Max retries exceeded with url: https://******... (Caused by SSLError(SSLCertVerificationError(1, '[SSL: CERTIFICATE_VERIFY_FAILED] certificate verify failed: unable to get …... 塵風

塵風- 0

- 0

- 724

-

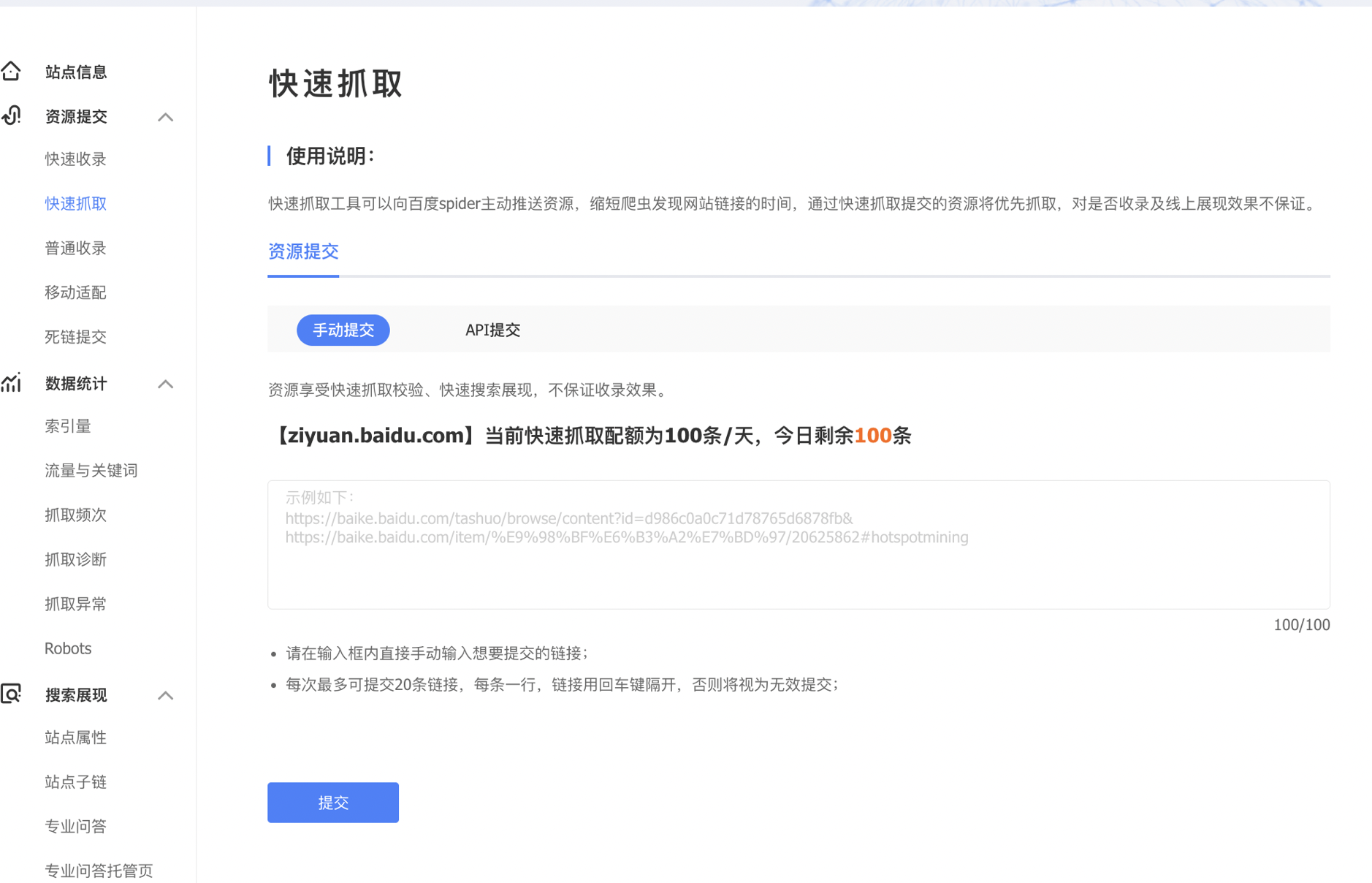

如何查询百度搜索资源平台API推送配额

查询百度搜索资源平台API推送配额可以直接推送然后获取返回的结果得到的我们的百度搜索资源平台API推送配额。 如果不想暂用托送额度查询的话,可以直接把推送一个星号*作为URL推送,那么会返回推送的结果,可以看到推送额度,这个*号会被当做不合规的URL,不会暂用我们的推送额度。 百度推送API结果说明 通过API地址推送后会返回json格式的数据,其中remain字段的值是当前剩余推送额度,详细解析…... 塵風

塵風- 0

- 0

- 638

-

使用Python检查提取网站死链

网站死链会影响我们的用户体验和搜索引擎对我们站点的评分(尤其是网站存在已经被做成赌博、色情网站的链接,影响很大),但是网站运营时长长了,就难免会有这样的问题,所以我们可以考虑定期的处理下,我之前分享过一些WordPress死链、外部链接处理的文章,如果你是使用WordPress,就可以直接参考下述的文章去解决: WordPress去除文章失效链接 WordPress文章外部链接清除 WordPre…... 塵風

塵風- 0

- 0

- 635

-

使用Python批量检查网站友情链接

外链对SEO的重要性到今天我想已经不用多说了,友情链接则是我们在优化过程中毕竟经常使用的一种增加外链方法,不过外链还是需要定期的检查的,毕竟一些站长下链卖站了可能不一定会提醒...或者有的网站已经不续费了,域名过期被抢注,直接做灰黑产业站点,我们又没下链,那么排名可能就会直接消失..哈哈哈,但是我们网站多了,又不可能一个个人工去检查,像我之前公司以前SEO订单多的时候要优化100+站点,自己又有一…... 塵風

塵風- 0

- 0

- 538

-

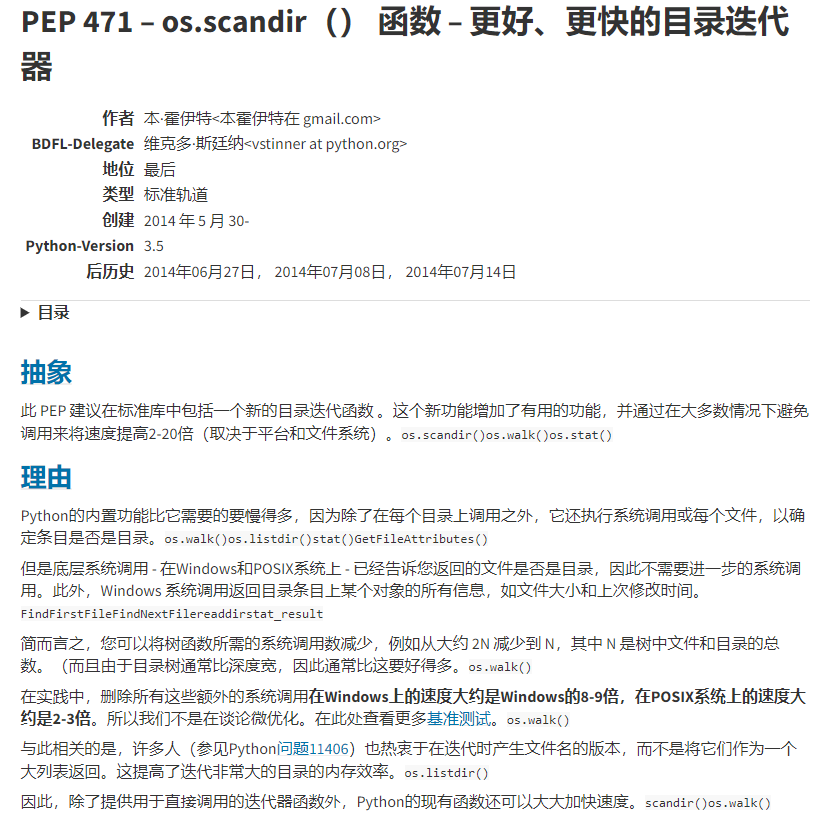

python os.scandir()函数

概述 在 Python 3.5版本中,新添加了 os.scandir()方法, scandir是一个目录迭代方法,返回一个DirEntry迭代器对象,它能告诉你迭代文件的路径。 os.scandir() 的运行效率要比 os.walk 高。 在 PEP 471 中,Python 官方也推荐我们使用 os.scandir() 来遍历目录。 相关文章:Python os.walk() 方法 官方介绍截…... 塵風

塵風- 0

- 0

- 1.8k

-

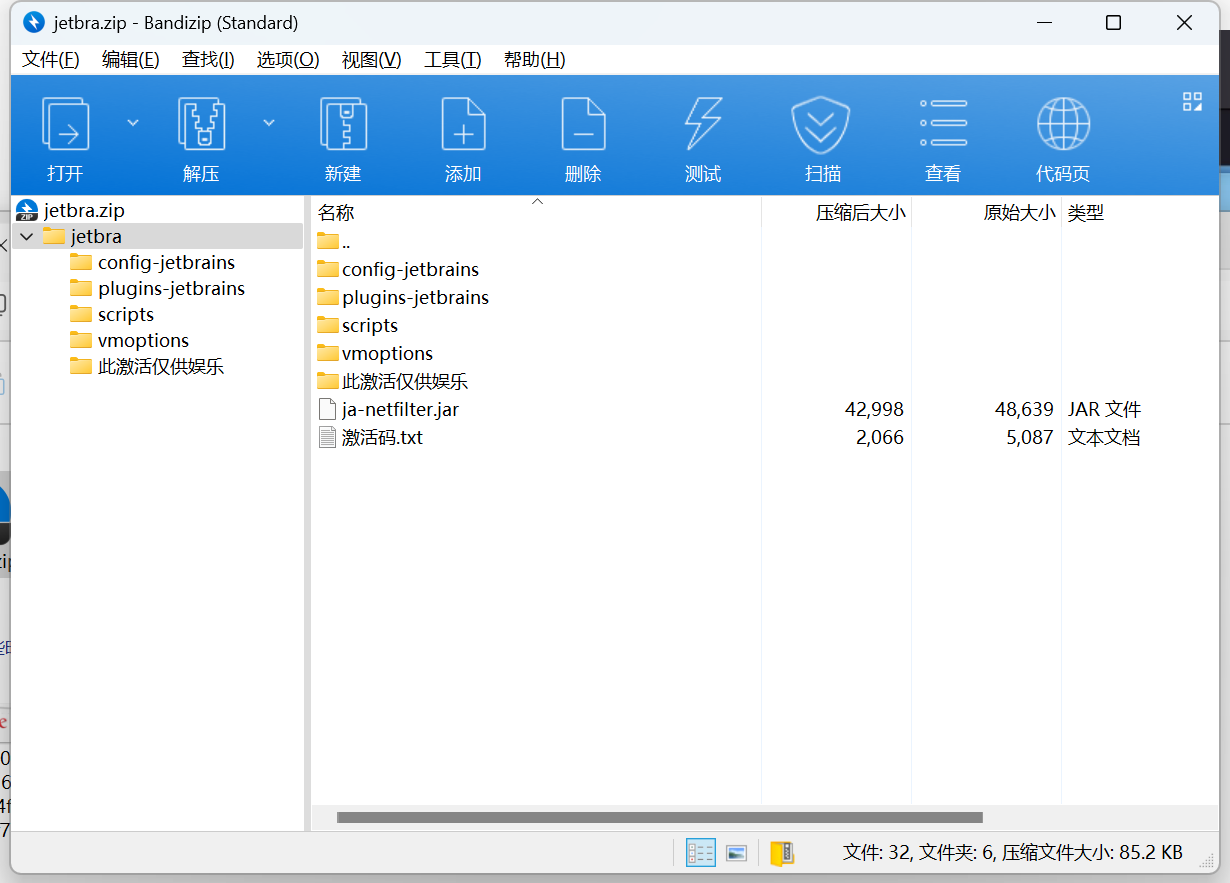

PyCharm破解教程(2023.3最新版本)

PyCharm破解教程(2023.3最新版本)分享,之前分享的:PyCharm破解教程(简单长期稳定)测试的破解是2021版本的,我已经有一段时间没用了,现在都是用这个,下面就开始分享: 准备工作 下载安装pycharm的详细过程请你看:Pycharm安装教程(非常详细) Windows电脑安装Python解释器请你看:Windows python安装教程(超详细) 激活工具 把下面的激活工具下载…... 塵風

塵風- 0

- 11

- 2.4k

![Python requests 异常Max retries exceeded with url: 请求地址… (Caused by SSLError(SSLCertVerificationError(1, ‘[SSL: CERTIFICATE_VERIFY_FAILED] certificate verify failed: unable to get local issuer certificate (_ssl.c:1129)’)))”))}解决](https://www.linfengnet.com/wp-content/uploads/2024/01/2024010606414043.png)